Bien, ya estudiamos en nuestras sesiones pasadas los métodos de ordenamiento interno. Ahora comenzaremos a analizar algunos de los métodos de ordenamiento externo.

Comenzando con el método de ordenamiento Radix. En esta entrada de nuestro blog, hablaremos un poco de el para que te des una idea de lo que trata.

Iniciemos entonces con un poco de los antecedentes históricos del mismo:

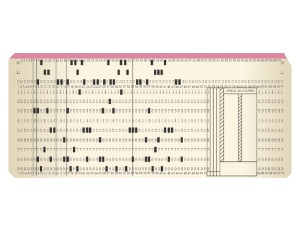

Se dice que este método nació de la idea de Herman Hollerith en 1890 al crear la máquina tabuladora, en la cual se empleaban tarjetas perforadas para realizar el censo de ese año en Estados Unidos.

Al final, después de unas horas, la maquina entregaba todo un grupo de hojas listas para ser procesadas en un computador.

En el censo de 1880 se tomaron 10 años para procesar toda la información, pero con las tarjetas perforadas, en la máquina que incluía un “card sorter” se tomaron cerca de 6 semanas.

La idea original de Hollerith era ordenar empezando por el digito más significativo.

Es de esta forma que surgio una maquina ordenadora de tarjetas. La cual, utilizando el método de Radix-Sort, concatenaba cada hoja dependiendo de la ubicación de las ultimas 3 columnas, que contenían las cifras para el acomodo de tarjetas, estando numerado del 0 al 9.

A este método también se le conoce como “ordenamiento de raíz”. Es un algoritmo de ordenamiento estable que puede ser usado para ordenar items identificados por llaves (o claves) únicas. Cada llave debe ser una cadena o un número capaz de ser ordenada alfanuméricamente.

Reglas para ordenar:

Empezar en el dígito más significativo y avanzar por los dígitos menos significativos mientras coinciden los dígitos correspondientes en los dos números. El número con el dígito más grande en la primera posición en la cual los dígitos de los dos números no coinciden es el mayor de los dos (por supuesto sí coinciden todos los dígitos de ambos números, son iguales). Este mismo principio se toma para Radix Sort.

A grandes rasgos este es el método Radix, en nuestra siguiente sesión analizaremos dicho método un poco más a fondo. Te comparto el siguiente video, para que dicho método te quede un poco más claro.

https://www.youtube.com/watch?v=nE2RVqC2mWQ

Bibliografía

IDHERR99. (08 de 10 de 2012). Youtube.com. Obtenido de https://www.youtube.com/watch?v=nE2RVqC2mWQ